Lista över de mest förekommande bedrägerierna med deepfakes.

Låt oss inleda med detta ”särskilda” meddelande från ”POTUS”, Joe Biden:

Detta ger en liten inblick i hur ett deepfake-bedrägeri (röst) kan se ut. I realiteten var detta ett kostnadsfritt AI-verktyg för röstkloning och det tog mig bara fem minuter att skriva (med ChatGPT) och klistra in texten för att transformera den till ett tal (av Biden).

Emellertid är deepfake-bedrägerier ofta mer avancerade än så här. Allt som krävs är några högkvalitativa fotografier, filmer eller ljud av den berörda personen (offret), samt ett kraftfullt grafikkort för att starta processen.

Vårt fokus här är emellertid inte hur man skapar deepfake-videor. Det handlar inte heller om att identifiera deepfakes.

Artikeln syftar istället till att ge en kort introduktion till deepfakes och uppmärksamma några av de bedrägerier som man bör vara medveten om.

Vad är Deepfakes?

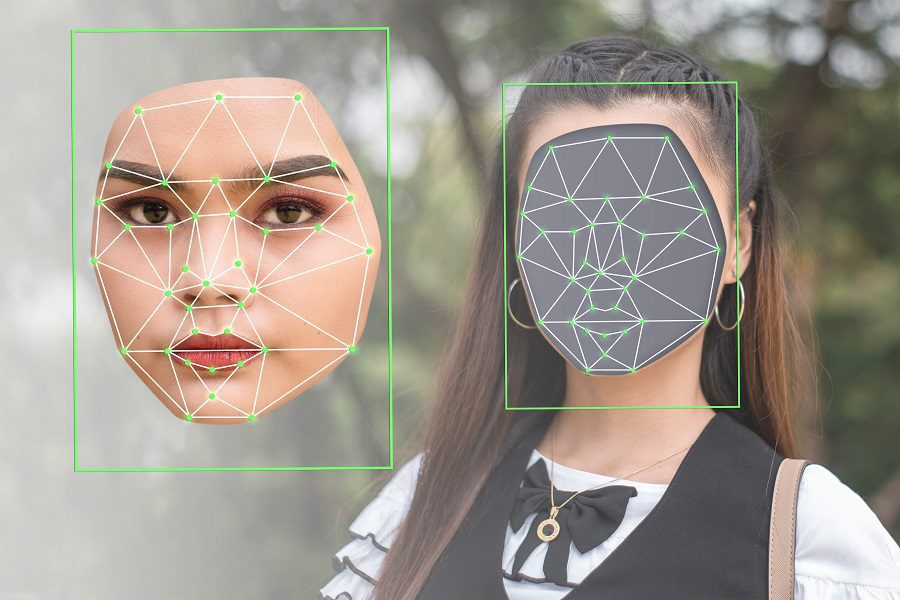

Deepfake är en sammansättning av två ord: ”Deep” (från deep learning, vilket är metoden som används för att skapa dem) och ”fake” (vilket indikerar resultatet).

I korta drag, deep learning-algoritmer används för att skapa realistiska bilder, ljud eller videoinnehåll från högupplöst originalmaterial.

Detta är ett klassiskt exempel på deepfake och är ganska effektivt. Dock är det fem år gammalt, och tekniken utvecklas snabbt.

Och detta görs inte alltid för underhållningens skull eller för att visa upp någons AI-kompetens. Ett allvarligt exempel är när ”Mr. Volodymyr Zelensky” uppmanades av sina styrkor att kapitulera under det pågående kriget mellan Ryssland och Ukraina.

Tyvärr är inte alla fall så uppenbara. Enligt Regula Forensics rapport från 2023, har 37 % av världens organisationer upplevt röstbedrägerier med deepfakes, 29 % har utsatts för syntetiska videobedrägerier och 46 % har varit utsatta för försök till identitetsstöld.

Det handlar alltså inte bara om underhållning, utan deepfakes används ofta för att sprida falsk information och missbrukas på många andra sätt, vilket kan vara farligt och traumatiskt för offren.

Dessutom är det inte enkelt att bekämpa deepfake-innehåll. De är en konsekvens av de stora framsteg som gjorts inom AI-tekniken och att sådana verktyg nu är allmänt tillgängliga för alla.

Därför är det främsta och mest effektiva försvaret vi har medvetenhet.

Låt oss därför utforska dessa aspekter och titta närmare på de olika typerna av deepfake-bedrägerier.

Typer av Deepfake-bedrägerier

Baserat på innehåll och syfte, kan deepfake-bedrägerier kategoriseras i olika former, såsom:

- Videoimitation

- Falska intervjuer

- Falska nyheter

- Röstbedrägeri

- Honungsfällor

- Kundsupport

- Rekommendationer

Följande avsnitt kommer att diskutera dessa i detalj och några av deras varianter.

Video-imitation

Detta är ett välkänt deepfake-bedrägeri där en påhittad video skapas som oftast efterliknar en känd person. Ett typiskt offer kan vara en president (som i Obama-deepfaken), en populär filmstjärna eller VD:n för ett välkänt företag.

Det som gör dem till lätta mål är att deras bilder, röster, etc. är lättillgängliga för allmänheten. Verktygen som skapar deepfake-videor fungerar väl med olika typer av input, som visar olika uttryck, ansiktsvinklar, ljusförhållanden, bakgrunder med mera.

Avsikten med en sådan imitation kan vara allt från rent nöje, till försök till utpressning, politiska motiv, förtal och annat.

I enstaka fall kan man se deepfake-videor av familjemedlemmar som begär pengar eller tillgång till värdefulla ägodelar.

Falska intervjuer

Falska intervjuer som använder sig av deepfake-teknik syftar ofta till att möjliggöra fjärrjobb eller distansanställningar. Dessa bedrägerier använder deepfake-videor i realtid via videokonferensprogram som Zoom.

Förutom risken att anställa en undermålig kandidat riskerar det anställande företaget att exponera sina tillgångar för en bedräglig person. Beroende på företagets verksamhet kan detta skada företagets resurser och även utgöra en fara för landets intressen.

Ett enklare mål med deepfake-intervjuer kan vara att erhålla betalning i värdefulla valutor.

Å andra sidan kan bedragare ta ut en avgift från godtrogna kandidater för att de ska få möjlighet att träffa ”branschledare” i jakt på sitt drömjobb.

Falska Nyheter

Det mest förekommande deepfake-bedrägeriet är falska nyheter. Sådana onlinekampanjer med felaktig information utgör risker som kan vara förödande i känsliga situationer som upplopp eller krig.

Det kan också smutskasta offentliga personer när deras deepfake-kopior uttalar sig som de aldrig har gjort i verkligheten.

Det som hjälper propagandan är sociala medier och streamingplattformar som YouTube som hjälper falska nyheter att spridas snabbt. Detta leder till en situation där vanliga användare blir förvirrade om vad som är äkta och vad som är falskt.

Röstbedrägeri

I likhet med deepfake-videor och bilder, är syntetiska röster en annan form av teknikdrivna bedrägerier.

I ett sådant fall hörde Jennifer DeStefano, bosatt i Arizona, sin 15-åriga dotter gråta i telefonen samtidigt som en mansröst krävde en miljon dollar i lösensumma. Mamman var övertygad om att hennes barn var i fara. Innan hon hann betala lösesumman kontaktade deras vän hennes man och bekräftade att dottern var i säkerhet.

DeStefano berättade senare om händelsen, att hon fullständigt trodde på rösten, inte bara på grund av hur den lät utan tonfallet och uttrycket, som exakt matchade hur hennes dotter brukar prata.

Detta kallas för röstkloning och genomförs med hjälp av original ljudexempel från källan.

Honungsfällor

Enligt den traditionella definitionen av en honungsfälla lockas en person in i en relation för att utvinna känslig information. Honungsfällor är oftast riktade mot högt uppsatta personer, som någon inom militären, högre regeringstjänstemän, medarbetare till politiker etc.

Med deepfake-teknik sker dessa honungsfällor oftast på nätet och kan genomföras av vem som helst i stor skala. Detta innebär att offret kan få kontaktförfrågningar från attraktiva personer via sociala medier, som snabbt blir intima med det slutgiltiga målet att utpressa pengar eller information.

Sådana deepfake-bedrägerier är ofta noga uttänkta operationer, som får pågå en tid innan de slutligen slår till.

Kundsupport

Bedrägerier med teknisk support är mycket vanliga. Du har säkert hört talas om bedrägerier där en ”Microsoft”-anställd ber dig att betala för att åtgärda din dators ”allvarliga” problem.

Innan deepfakes avslöjades de skadliga försöken genom accent eller ovanliga talmönster. Men nu har dessa bedragare AI-superkrafter som enkelt kan lura godtrogna användare att tro att de faktiskt pratar med en legitim representant för företaget.

Rekommendationer

Många av oss läser kundrecensioner innan vi köper en produkt. Att kolla videorekommendationer är en annan shoppingvana som visat sig vara användbar fram tills nu.

Denna typ av deepfake-bedrägeri innebär att många personer rekommenderar en dålig produkt, vilket påverkar köpbesluten och slösar bort kundernas pengar och tid.

Det finns många fler!

Vad ser du på internet förutom text?

Jag skulle säga videor, bilder och ljud. Allt detta kan manipuleras med denna AI-teknik, vilket gör internet till en grogrund för bedrägerier i en inte alltför avlägsen framtid. Dessutom blir deepfake-skapandet allt enklare, vilket gör det svårt för den genomsnittliga internetanvändaren att hålla sig ”korrekt” informerad.

I en sådan situation, där det knappt finns något som hindrar det utbredda missbruket av tekniken, bör vi åtminstone försöka hålla oss uppdaterade.

PS: När det kommer till roliga applikationer finns det deepfake-appar som kan skapa de bästa memes för att dominera sociala medier.